人工知能(AI)は急速に サイバーセキュリティ 複雑な課題に対する革新的な解決策を提示する、革新的な景観。しかし、この革新は重要な疑問を提起する。

- 責任ある使用を確保し、被害を最小限に抑えるために、AI ガバナンスにどのように取り組むべきでしょうか?

- AI によってイノベーションと機密性のバランスを取ることが不可能になるのでしょうか?

Swimlaneは、お客様の組織にとって安全かつ効果的な、最先端かつ先進的なイノベーションの推進に尽力しています。透明性と組み合わせることで、組織がノイズを排除し、情報に基づいた意思決定を行えるよう支援します。.

私たちは最近、 サピオリサーチ AIガバナンスをめぐる進行中の議論を探るため、米国と英国のサイバーセキュリティリーダー500名を対象に調査を実施しました。調査結果では、AIの監督責任を誰が担うべきかという点について意見が分かれていることが明らかになり、政府とベンダーの責任に関する重要な視点が浮き彫りになりました。.

当社の調査は貴重な洞察を提供していますが、過去および現在の最高情報セキュリティ責任者(CISO)の率直な視点には、他に類を見ないほどの力強さがあります。最近のウェビナーでは、, AIの現実検証:CISOがサイバーセキュリティにおけるAIの役割を解説, TAG Cyber CEO、元AT&T CISO エド・アモロソ スイムレーンCISOに入社 マイケル・ライボーグ 研究結果とサイバーセキュリティにおける AI の現状について深く議論します。.

このブログは、ウェビナーで共有された調査データと専門家の視点をまとめた3部構成のシリーズの第1弾です。引き続き主要な調査結果をご覧ください。さらに詳しい情報については、レポート全文をダウンロードしてください。 AI はサイバーセキュリティの約束を果たしているでしょうか?

主要なAI研究結果

政策と実践のパラドックス

70%の組織が公開大規模言語モデル(LLM)とのデータ共有に関するプロトコルを整備している一方で、74%の組織が従業員がこれらのモデルに機密データを入力していることを認識しています。これは、ポリシーと実践の間にギャップがあることを示しています。.

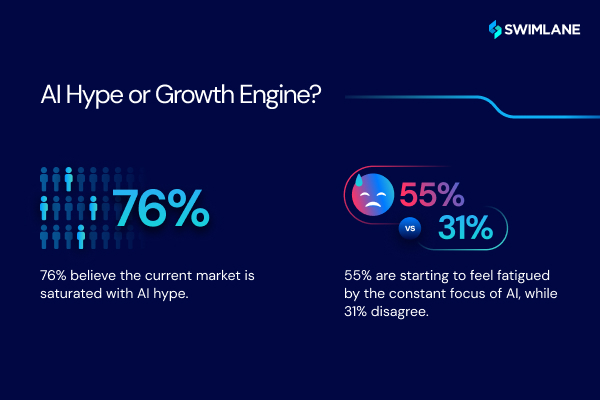

AIのハイプサイクル:疲労と導入

AI 疲労と懐疑心が高まる中、AI と機械学習 (ML) の専門知識に対する需要が、人材の優先順位を決定づけ続けています。.

しかし、回答者の85%が、AIと機械学習の経験が採用決定に影響を与えていると認めており、対照的です。これは、誇大宣伝にもかかわらず、AIスキルが労働力においてますます評価されていることを示唆しています。.

AIは過大評価されているだけなのか、それとも本当に成長を牽引しているのだろうか?この問いは依然として議論の余地があるものの、先日開催されたウェビナーでは、現職および元CISOの知見を披露し、このテーマを深く掘り下げました。.

で AIの現実:CISOがサイバーセキュリティにおけるAIの役割を解説, スイムレーンのCISOマイク・ライボーグ氏とタグ・サイバーのCEOエド・アモロソ氏は、AIが今日、具体的なソリューションを提供していることに同意しました。しかし、AIを過度に宣伝し、実世界のユースケースを示さないベンダーは、ノイズを増やすだけであり、セキュリティリーダーやバイヤーがAIの真価を見抜くのを困難にすると強調しました。.

AI業界の圧倒的な専門用語を理解するのが難しい場合は、このブログをご覧ください。 AIセキュリティベンダーに尋ねるべき8つの重要な質問 雑音を排除し、より情報に基づいた意思決定を行うのに役立ちます。.

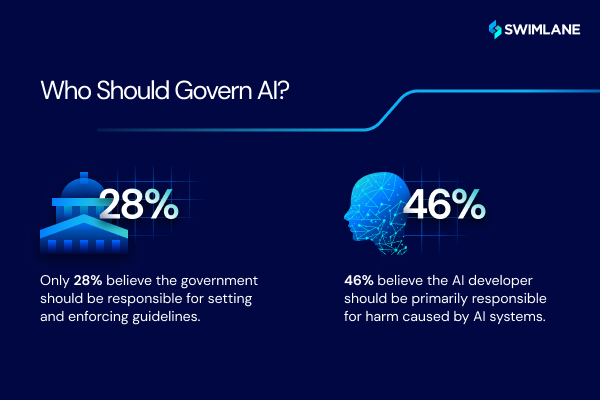

AIガバナンスに関する議論

当社の調査レポートでは、AIガバナンスの重要な問題も調査し、次のような分かれた視点を浮き彫りにしています。

- 限定的な政府の役割: 回答者のわずか28%が、AIガバナンスの主な責任は政府にあるべきだと考えています。.

- ベンダーの責任: ほぼ半数 (46%) は、AI システムが損害を引き起こした場合、その結果に対して AI を開発している企業が主な責任を負うべきだと考えています。.

この分断された状況を理解するために、CISOエキスパートに現実的な視点を伺いました。彼らの意見を以下にまとめました。.

- 有機的なガバナンス: アモローソ氏とライボーグ氏は共に、テクノロジー自体と共に進化する有機的なAIガバナンスの必要性を強調しています。彼らは、政府による高圧的な介入に対して警鐘を鳴らしています。.

- 個人の責任: CISO は、ベンダーと組織の役割を認めつつ、AI ツールを倫理的かつ責任を持って使用する際の個人の責任の重要性を強調しました。.

AI時代のCISOのためのヒントとポイント

研究データと専門家の視点の両方から、サイバーセキュリティにおけるAIへのバランスの取れたアプローチの必要性が浮き彫りになっています。AIはイノベーションの大きな可能性を秘めていますが、組織は機密性に対するリスクに積極的に対処する必要があります。具体的には、以下の点が挙げられます。

- 明確なポリシーとトレーニング: AI の使用に関する明確なポリシーを確立して施行し、包括的な従業員トレーニングを行うことが不可欠です。.

- 価値に焦点を当てる: AI の誇大宣伝を排除し、真の価値をもたらすソリューションに焦点を当てることが重要です。.

- 協働ガバナンス: AI の複雑な状況を把握し、責任ある倫理的な使用を確保するには、政府機関、ベンダー、個々のユーザーが関与するガバナンスへの協調的なアプローチが必要です。.

AIは万能薬ではない サイバーセキュリティの課題. しかし、思慮深いガバナンスとイノベーションと機密性のバランスに重点を置けば、AIはセキュリティ体制を強化する強力なツールとなり得ます。重要なのは、AIの力を活用しながらリスクを軽減し、イノベーションが機密性を犠牲にしないようにすることです。.

TAGサイバー技術レポート:SecOps自動化におけるAIの活用

アナリストレポートは、SOAR市場の簡単な概要と、SwimlaneがSOARからAIを活用したセキュリティ自動化プラットフォームへとどのように変革したかというストーリーから始まります。SwimlaneのAI活用についてさらに詳しく知りたい方は、レポート全文をお読みください。.