AIエージェントのより良い天使:自律システムにおける倫理的サイバーセキュリティ

AIエージェントとは何ですか?

組織が自らに代わって自律的に意思決定を行い、行動を起こす権限を付与した、目標指向型のソフトウェアエンティティ。これらのエンティティは、AI技術に加え、メモリ、プランニング、ツール、ガードレールといったコンポーネントを組み合わせることで、最小限の人間による監視でタスクを完了し、目標を達成します。.

サーバーのざわめき、画面のちらつき、技術革新の容赦ない進歩。まるで、制御不能な力によって形作られる未来へと突き進んでいるかのような感覚に襲われるかもしれません。しかし、AIエージェント革命の瀬戸際に立つ今、私たちにはその進路を舵取りする絶好の機会が訪れています。これは単により賢い機械を作ることではなく、エイブラハム・リンカーンが「人間の本性のより良き天使」と呼んだ、協力、共感、そして集団の善へと導く高貴な衝動を呼び起こすことです。スティーブン・ピンカーが、人類が数千年にわたり、暴力を減らし理性を高めるために、いかにしてより良き天使を受け入れてきたかを詳細に記述したように、私たちは今、自律型AIエージェントにまさに同じ原則を意識的に浸透させ、コストのかかるエラーやサイバーセキュリティのリスクを削減しなければなりません。.

自律型インテリジェンスの台頭:サイバーセキュリティの進歩における新たな章

AI エージェントが複雑なサイバーセキュリティ プロジェクトをプロアクティブに管理し、期限を通知するだけでなく、セキュリティ データを分析し、インシデント対応タスクを他のエージェントに委任し、初期の脅威レポートの作成まで行ってくれる世界を想像してみてください。その間、セキュリティ運用の創造的かつ戦略的な中核業務に集中できます。.

AIエージェントの将来性

これは遠い空想ではなく、AIエージェントが実現する未来の姿です。単に指示に応答するだけの受動的なAIツールとは異なり、これらは自律的なAIエンティティであり、セキュリティ目標を理解し、脅威の検知と対応のための段階的なソリューションを計画し、環境から学習し、人間の介入を最小限に抑えてアクションを実行できます。つまり、彼らはデジタルの弟子であり、未来の信頼できるパートナーへと進化していく能力を持っています。 セキュリティオペレーションセンター(SOC).

AIの未来:受動的なエージェントから能動的なエージェントへの移行

受動的なツールから能動的な協力者へのこの移行は、画期的な飛躍です。まるで計算機(リアクティブ)からサイバーセキュリティアナリスト(プロアクティブ)への移行のようなものです。ただし、その範囲と能力ははるかに広範です。AIの未来は、これらのエージェントの開発と本質的に結びついており、セキュリティ運用を再定義し、脅威インテリジェンスを加速し、私たちがまだ理解し始めたばかりの方法で防御戦略をパーソナライズすることを約束しています。.

倫理的責務:サイバーセキュリティのためのコードにおける「より良い天使」の育成

しかし、巨大な力には巨大な責任が伴う。ピンカーが司法制度や商業といった社会の仕組みがいかに私たちの善意を増幅させてきたかを示したように、サイバーセキュリティのためのAIエージェントにも同様の「仕組み」を組み込む必要がある。.

意図的な人間中心のアプローチがなければ、これらの強力なツールは、意図せずして人間の弱点を増幅させ、脅威検知におけるバイアス、インシデント対応の非効率性、さらには設定ミスや誤検知による意図しない損害さえも引き起こす可能性があります。ここで、倫理的AI原則の概念は単なる理論的なものではなく、サイバーセキュリティ分野におけるAIエージェントの開発において極めて重要になります。.

ピンカーが人間の持つ「良き天使」の一つとして挙げた「共感」、つまり共感と気遣いの能力について考えてみましょう。SOCで運用されるAIエージェントに、デジタル版の同等の能力をどのように組み込めばよいでしょうか?その答えはこうです。

透明性と説明責任:セキュリティのための解釈可能なAIの構築

AIエージェントが組織のセキュリティ体制や重大なインシデント対応に影響を与える決定を下す場合、私たちは理解する必要がある。 なぜ そして どうやって その決定に至ったのです。これは単にデータを記録するだけではありません。脅威評価と緩和策の背後にあるロジックを人間のアナリストがアクセスし、監査できる、解釈可能なAIシステムを構築することです。.

人間参加型設計:人間による監督の重要な役割

SOCにおける最も洗練されたAIエージェントでさえ、見守る保護者が必要です。ピンカーが理性によって衝動的な行動を控えることができると主張するように、人間による監視は自律型セキュリティシステムにとって必要な「一時停止ボタン」と道徳的な羅針盤となります。私たちは、容易な介入、進路修正、そして重要なセキュリティ上の意思決定において人間の判断が最終的な権限となるようなインターフェースを設計しなければなりません。.

公平性とバイアスの緩和:サイバーセキュリティにおける責任あるAIの構築

私たちのデジタル世界は、データに歴史的バイアスが蔓延しており、綿密に対処しなければ、既存の脅威情報やセキュリティログから学習するAIエージェントによって、これらのバイアスが取り込まれ、増幅されてしまうでしょう。責任あるデータの作成 サイバーセキュリティにおけるAI これらのバイアスを積極的に特定して軽減し、エージェントがすべてのシステムとユーザーを公平に考慮し、特定のグループやアプリケーションを不当にターゲットにしないことを保証します。.

目的主導型開発:AI の能力を社会全体の利益のために活用する

私たちは、これらのエージェントの驚異的な能力を、サイバーセキュリティ全体の利益のために意識的に活用しなければなりません。これは、セキュリティ分野におけるAIの活用を促進し、ランサムウェアや高度な持続的脅威といった複雑でグローバルな課題に対処し、重要インフラを保護するエージェントを設計することを意味します。AIエージェントが脅威ハンティングをリアルタイムで最適化したり、新たな脆弱性の発見を加速させたりすることを想像してみてください。.

サイバーセキュリティにおける人間中心のAIアプローチの実践的ステップ

AI エージェントの「より良い天使」を受け入れることは受動的な希望ではなく、サイバーセキュリティの分野を超えたコラボレーションを必要とする積極的な取り組みです。.

- 開発者および企業向け: 責任は設計段階から始まります。AIエージェント開発のセキュリティ基盤そのものに、倫理的な枠組みを組み込む必要があります。これには、自動応答における意図しない結果に対する厳格なテスト、エージェント自体の誤用や侵害を防ぐための堅牢なセキュリティの優先、そしてセキュリティアナリストを威圧するのではなく、力強くサポートする直感的な制御インターフェースの構築が含まれます。.

- 規制当局および政策立案者向け: サイバー脅威とAIのグローバルな性質は、国際協力を必要としています。柔軟かつ強固なAIガバナンスの枠組みは、セキュリティソリューションのイノベーションを促進しつつ、自律システムによるリスクから保護するために不可欠です。AIの安全性研究への投資は、技術的な解決策の探求だけでなく、自律セキュリティシステムの普及が社会に及ぼす影響の検証も伴うため、極めて重要です。.

- ユーザーと一般の皆様へ: 私たちの役割は、情報を得て、積極的に関与することです。私たちは、私たちが関わるAIエージェントの透明性とコントロールを求め、その限界を理解し、私たちのデジタルライフを守るための倫理的な導入を主張しなければなりません。私たちの集合的な声が、この技術の方向性を形作ることができるのです。.

サイバーセキュリティにおける意識的なAIと人間の共存への呼びかけ

ピンカーが雄弁に論じているように、「人間の本性に宿る善き天使たち」は、人類をゆっくりと、しかし確実に、より平和で豊かな存在へと導いてきた強力な力です。サイバーセキュリティにおけるAIエージェント時代の入り口に立つ今、私たちはこれらの強力な新たな存在に、同じ高貴な衝動を吹き込むという、計り知れない機会、そしてまさに道徳的義務を担っています。.

サイバーセキュリティにおけるAIエージェントの未来は、あらかじめ定められたものではありません。それは、私たち設計者、政策立案者、そしてセキュリティ専門家が描くキャンバスなのです。人間中心のAIが単なる流行語ではなく、指針となる哲学となる未来を、共に描きましょう。AIエージェントがインテリジェントで、セキュリティ上の意思決定においても賢明であり、脅威への対応において効率的であるだけでなく、運用においても倫理的である未来です。私たちの最も深い価値観を反映したエージェントを意識的に構築し、SOCにおける人間の可能性を高め、私たち自身の「より良い天使」によって形作られる未来に向けて、たゆまぬ努力を続けましょう。“

要約

サイバーセキュリティにおける自律型 AI エージェントへの移行には、信頼性を確保するために、透明性、人間による監視、バイアスの緩和といった倫理原則 (「ベター エンジェル」) を意識的に組み込む必要があります。.

この人間中心のアプローチにより、AI エージェントは単なるツールから信頼できる倫理的なパートナーへと変化し、セキュリティ チームが自信を持って真に責任あるエージェントを展開できるようになります。.

報告

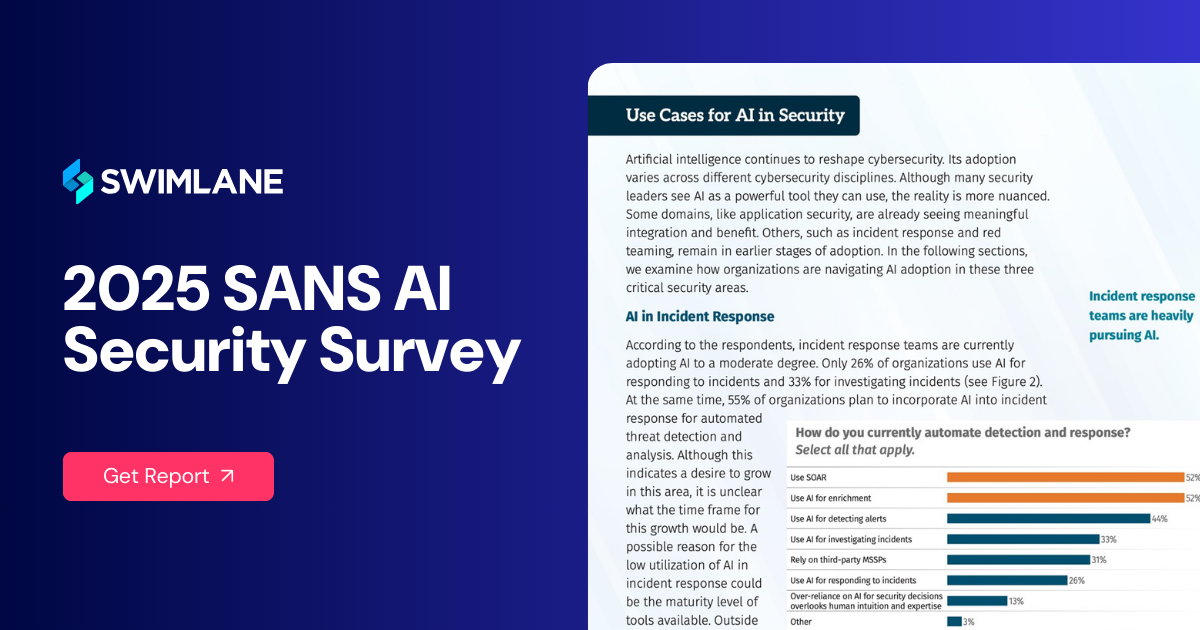

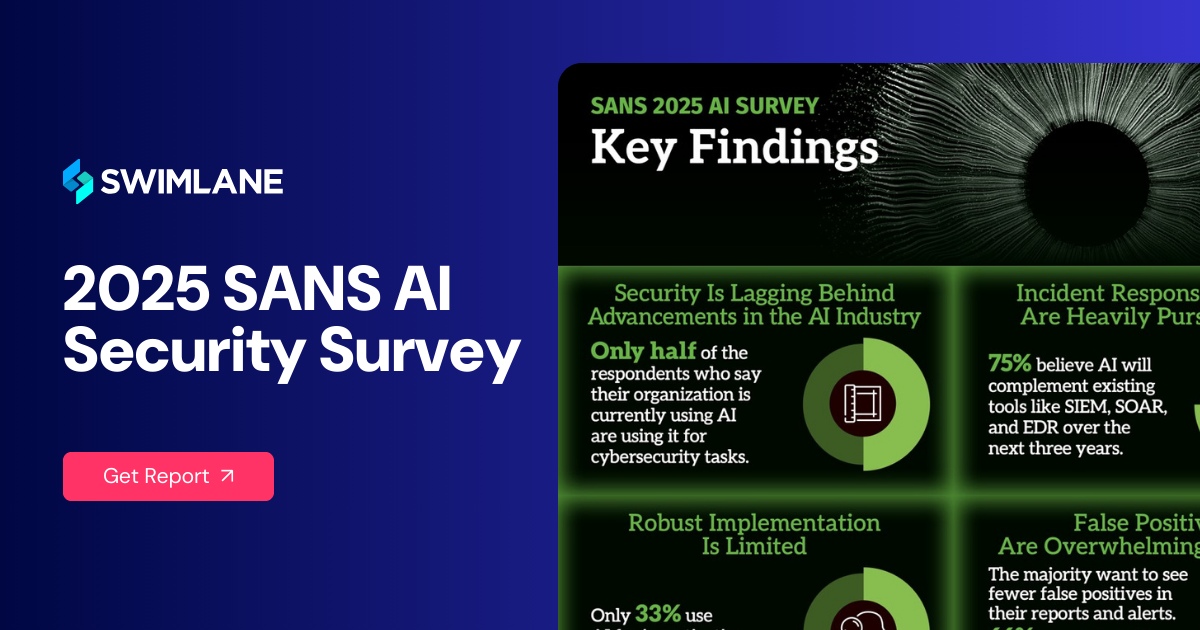

SANS 2025 AI調査:3年後のAIのセキュリティへの影響

生成 AI (GenAI) と大規模言語モデル (LLM) はすでに存在し、サイバーセキュリティの状況を形成しています。.

Ahmed Abugharbia 氏と Brandon Evans 氏が執筆した 2025 SANS AI 調査では、組織が現在セキュリティのために GenAI をどのように活用しているかを調査し、これらの新しいテクノロジーがもたらす問題と脅威を特定しています。.