Mejores ángeles de los agentes de IA: Ciberseguridad ética en sistemas autónomos

¿Qué es un agente de IA?

Una entidad de software orientada a objetivos a la que una organización ha otorgado el derecho de actuar en su nombre para tomar decisiones y actuar de forma autónoma. Estas entidades utilizan técnicas de IA, combinadas con componentes como memoria, planificación, herramientas y barreras de seguridad, para completar tareas y alcanzar objetivos con mínima supervisión humana.

El zumbido de los servidores, el parpadeo de las pantallas, la implacable marcha del progreso tecnológico: puede parecer que nos precipitamos hacia un futuro moldeado por fuerzas que escapan a nuestro control. Sin embargo, al borde de la revolución de los agentes de IA, tenemos una gran oportunidad de guiar su rumbo. No se trata solo de construir máquinas más inteligentes; se trata de invocar lo que Abraham Lincoln llamó célebremente "los mejores ángeles de nuestra naturaleza", esos impulsos más nobles que nos guían hacia la cooperación, la empatía y el bien colectivo. Así como Steven Pinker detalló meticulosamente cómo la humanidad, a lo largo de milenios, ha adoptado cada vez más sus mejores ángeles para reducir la violencia y elevar la razón, ahora debemos imbuir conscientemente a nuestros agentes autónomos de IA con los mismos principios, reduciendo así los costosos errores y los riesgos de ciberseguridad.

El auge de la inteligencia autónoma: un nuevo capítulo en el progreso de la ciberseguridad

Imagine un mundo donde su agente de IA administra de forma proactiva sus proyectos complejos de ciberseguridad, no solo recordándole los plazos, sino analizando datos de seguridad, delegando tareas de respuesta a incidentes a otros agentes e incluso redactando informes iniciales de amenazas, todo mientras usted se concentra en el núcleo creativo y estratégico de sus operaciones de seguridad.

La promesa de los agentes de IA

Esto no es una fantasía lejana; es la promesa de los agentes de IA. A diferencia de las herramientas de IA reactivas que simplemente responden a sus órdenes, estas son entidades de IA autónomas capaces de comprender los objetivos de seguridad, planificar soluciones de varios pasos para la detección y respuesta a amenazas, aprender de su entorno y ejecutar acciones con mínima intervención humana. Son, en esencia, aprendices digitales, capaces de convertirse en socios de confianza en el... Centro de Operaciones de Seguridad (SOC).

El futuro de la IA: un cambio de agentes pasivos a proactivos

Este cambio de herramientas pasivas a colaboradores proactivos representa un salto monumental. Es como pasar de una calculadora (reactiva) a un analista de ciberseguridad (proactivo), pero con un alcance y una capacidad mucho mayores. El futuro de la IA está intrínsecamente ligado al desarrollo de estos agentes, que prometen redefinir las operaciones de seguridad, acelerar la inteligencia de amenazas y personalizar las estrategias de defensa de maneras que apenas comenzamos a comprender.

El imperativo ético: fomentar a nuestros mejores ángeles en el código de la ciberseguridad

Sin embargo, un inmenso poder conlleva una inmensa responsabilidad. Así como Pinker ilustra cómo mecanismos sociales como los sistemas judiciales y el comercio han potenciado nuestra capacidad de ser mejores ángeles, debemos diseñar "mecanismos" similares en nuestros agentes de IA para la ciberseguridad.

Sin un enfoque deliberado y centrado en el ser humano, estas potentes herramientas podrían, sin querer, amplificar nuestros peores enemigos, los sesgos en la detección de amenazas, las ineficiencias en la respuesta a incidentes e incluso daños involuntarios debido a configuraciones incorrectas o falsos positivos. Aquí es donde el concepto de principios éticos de IA se vuelve no solo teórico, sino absolutamente crucial para el desarrollo de agentes de IA en el ámbito de la ciberseguridad.

Consideremos la "simpatía" que Pinker describe como uno de los mejores ángeles de la humanidad, como nuestra capacidad de empatía y cuidado. ¿Cómo inculcamos un equivalente digital en un agente de IA que opera en un SOC? Comienza con:

Transparencia y rendición de cuentas: desarrollo de una IA interpretable para la seguridad

Si un agente de IA toma una decisión que afecta la postura de seguridad de una organización o una respuesta a un incidente importante, debemos comprender por qué y cómo Se llegó a esa decisión. No se trata solo de registrar datos; se trata de construir sistemas de IA interpretables donde la lógica detrás de las evaluaciones de amenazas y las acciones de mitigación sea accesible y auditable por analistas humanos.

Diseño con intervención humana: el papel esencial de la supervisión humana

Incluso los agentes de IA más sofisticados en un SOC necesitan un guardián vigilante. Así como Pinker argumenta que la razón nos permite evitar acciones impulsivas, la supervisión humana proporciona el "botón de pausa" y la brújula moral necesarios para los sistemas de seguridad autónomos. Debemos diseñar interfaces que faciliten la intervención, la corrección del rumbo y la máxima autoridad del juicio humano en decisiones críticas de seguridad.

Equidad y mitigación de sesgos: desarrollo de una IA responsable en ciberseguridad

Nuestro mundo digital está plagado de sesgos históricos en los datos y, si no se abordan meticulosamente, estos sesgos serán asimilados y amplificados por agentes de IA que aprenden de la inteligencia de amenazas o los registros de seguridad existentes. Elaborar datos responsables IA en ciberseguridad implica identificar y mitigar proactivamente estos sesgos, garantizando que los agentes consideren todos los sistemas y usuarios con equidad y no se dirijan injustamente a grupos o aplicaciones específicos.

Desarrollo con propósito: Orientar las capacidades de la IA hacia el bien común

Debemos dirigir conscientemente las increíbles capacidades de estos agentes hacia el bien común de la ciberseguridad. Esto implica impulsar iniciativas de IA para el bien común en seguridad, diseñar agentes que aborden desafíos globales complejos como el ransomware, las amenazas persistentes avanzadas y la protección de infraestructuras críticas. Imagine agentes de IA optimizando la detección de amenazas en tiempo real o acelerando el descubrimiento de nuevas vulnerabilidades.

Pasos prácticos para un enfoque de IA centrado en el ser humano en ciberseguridad

Adoptar los “mejores ángeles” de los agentes de IA no es una esperanza pasiva; es un esfuerzo activo que requiere colaboración entre disciplinas en ciberseguridad.

- Para desarrolladores y empresas: La responsabilidad empieza desde el principio. Debemos integrar marcos éticos en la arquitectura misma del desarrollo de agentes de IA para la seguridad. Esto incluye pruebas rigurosas para detectar consecuencias imprevistas en las respuestas automatizadas, priorizar una seguridad robusta para evitar el uso indebido o la vulneración de los propios agentes, y crear interfaces de control intuitivas que empoderen a los analistas de seguridad en lugar de intimidarlos.

- Para reguladores y formuladores de políticas: La naturaleza global de las ciberamenazas y la IA exige cooperación internacional. Es fundamental contar con marcos de gobernanza de la IA flexibles pero sólidos, que fomenten la innovación en soluciones de seguridad y protejan contra los riesgos que plantean los sistemas autónomos. Invertir en investigación sobre seguridad de la IA es crucial, ya que implica explorar soluciones técnicas y examinar las implicaciones sociales de la generalización de los sistemas de seguridad autónomos.

- Para usuarios y público: Nuestro papel es estar informados y comprometidos. Debemos exigir transparencia y control sobre los agentes de IA con los que interactuamos, comprender sus limitaciones y abogar por su implementación ética para proteger nuestra vida digital. Nuestra voz colectiva puede definir el rumbo de esta tecnología.

Un llamado a la IA consciente y la coexistencia humana en la ciberseguridad

Los "mejores ángeles de nuestra naturaleza", como argumenta Pinker con tanta elocuencia, son fuerzas poderosas que, lenta pero seguramente, han guiado a la humanidad hacia una existencia más pacífica y próspera. Ahora, al encontrarnos en el umbral de la era de los agentes de IA en ciberseguridad, tenemos la gran oportunidad, y de hecho la obligación moral, de imbuir a estas nuevas y poderosas entidades con los mismos nobles impulsos.

El futuro de los agentes de IA en ciberseguridad no está predestinado. Es un lienzo sobre el que nosotros, como diseñadores, legisladores y profesionales de la seguridad, pintaremos. Optemos por pintar un futuro donde la IA centrada en el ser humano no sea solo una palabra de moda, sino una filosofía rectora. Un futuro donde los agentes de IA sean inteligentes y sabios en sus decisiones de seguridad; no solo eficientes en la respuesta a amenazas, sino también éticos en sus operaciones. Optemos conscientemente por construir agentes que reflejen nuestros valores más profundos, potenciando el potencial humano en el SOC y trabajando incansablemente por un futuro moldeado por nuestros mejores ángeles.“

Resumen

La transición hacia agentes de IA autónomos en ciberseguridad requiere incorporar conscientemente principios éticos (“ángeles mejores”), específicamente, transparencia, supervisión humana y mitigación de sesgos para garantizar que sean confiables.

Este enfoque centrado en el ser humano transforma a los agentes de IA de simples herramientas en socios confiables y éticos, lo que garantiza que los equipos de seguridad puedan implementar con confianza agentes verdaderamente responsables.

Informe

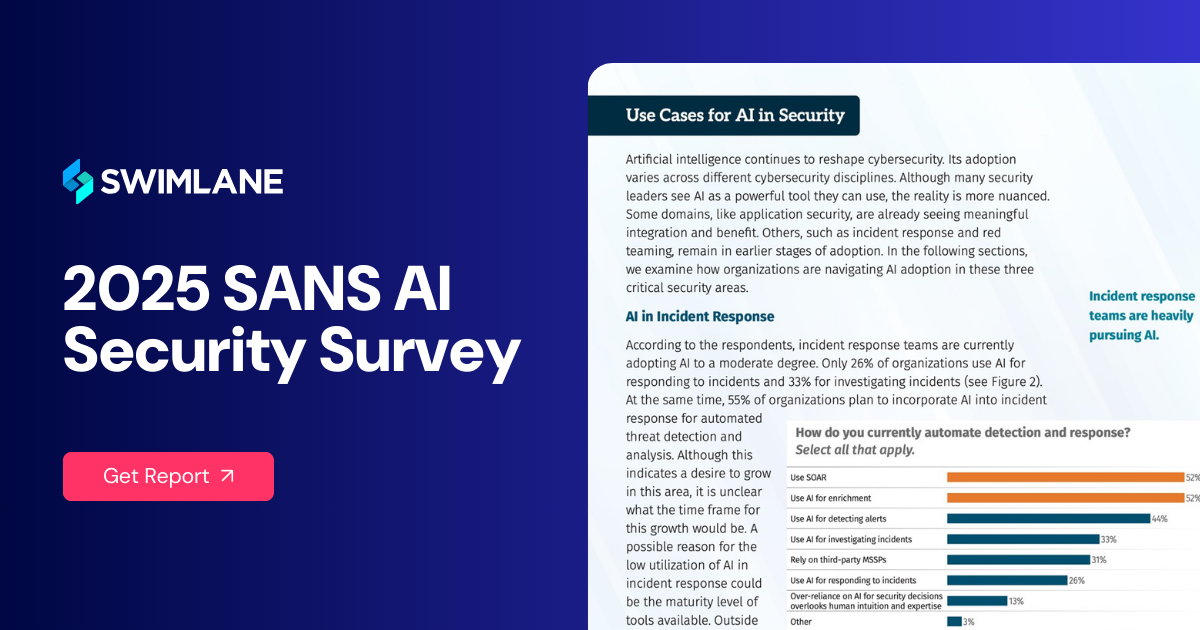

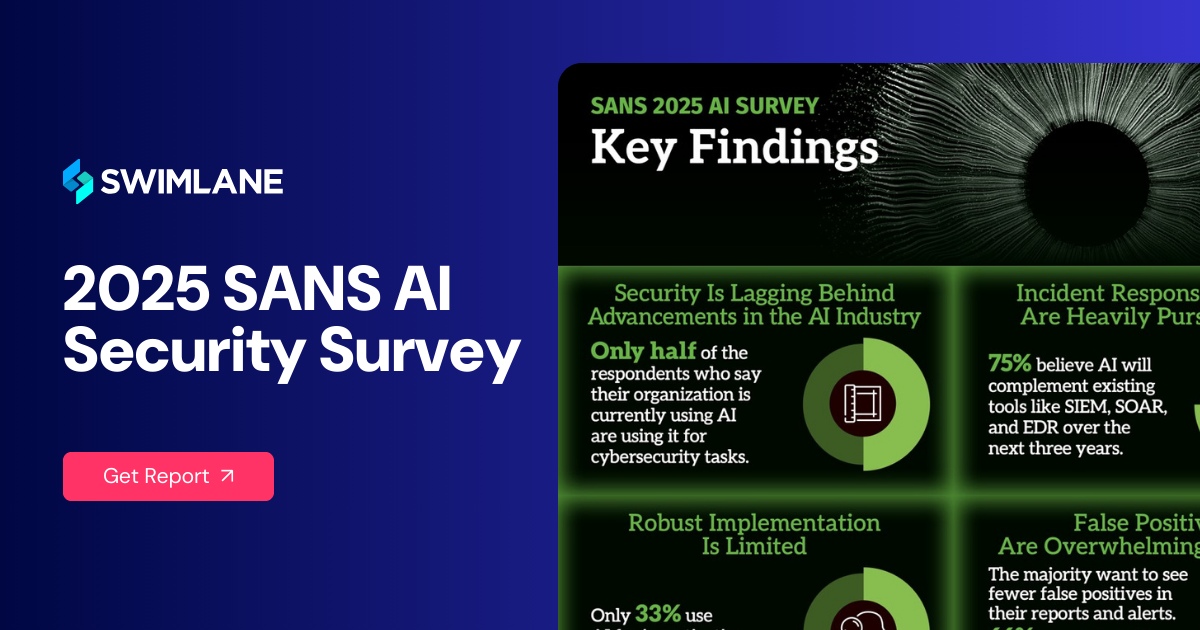

Encuesta de IA SANS 2025: El impacto de la IA en la seguridad tres años después

La IA generativa (GenAI) y los modelos de lenguaje grandes (LLM) ya están aquí y están dando forma al panorama de la ciberseguridad.

La encuesta SANS AI 2025, escrita por Ahmed Abugharbia y Brandon Evans, examina cómo las organizaciones utilizan actualmente GenAI para la seguridad e identifica los problemas y las amenazas que plantean estas nuevas tecnologías.