Die besseren Seiten von KI-Agenten: Ethische Cybersicherheit in autonomen Systemen

Was ist ein KI-Agent?

Eine zielorientierte Softwareeinheit, der eine Organisation das Recht eingeräumt hat, in ihrem Namen autonom Entscheidungen zu treffen und Maßnahmen zu ergreifen. Diese Einheiten nutzen KI-Techniken in Kombination mit Komponenten wie Speicher, Planung, Werkzeugen und Schutzmechanismen, um Aufgaben mit minimaler menschlicher Aufsicht zu erledigen und Ziele zu erreichen.

Das Summen der Server, das Flackern der Bildschirme, der unaufhaltsame Fortschritt der Technologie – es kann sich anfühlen, als würden wir in eine Zukunft rasen, die von Kräften geformt wird, die wir nicht kontrollieren können. Doch am Rande der Revolution der KI-Agenten bietet sich uns die einmalige Chance, ihren Kurs zu lenken. Es geht nicht nur darum, intelligentere Maschinen zu entwickeln, sondern darum, das zu erwecken, was Abraham Lincoln einst als “die besseren Engel unserer Natur” bezeichnete – jene edleren Impulse, die uns zu Kooperation, Empathie und dem Gemeinwohl führen. So wie Steven Pinker detailliert beschrieben hat, wie die Menschheit über Jahrtausende hinweg zunehmend ihre besseren Engel genutzt hat, um Gewalt zu reduzieren und die Vernunft zu fördern, müssen wir nun bewusst unsere autonomen KI-Agenten mit genau diesen Prinzipien ausstatten, um kostspielige Fehler und Cybersicherheitsrisiken zu minimieren.

Der Aufstieg autonomer Intelligenz: Ein neues Kapitel im Fortschritt der Cybersicherheit

Stellen Sie sich eine Welt vor, in der Ihr KI-Agent Ihre komplexen Cybersicherheitsprojekte proaktiv managt, Sie nicht nur an Fristen erinnert, sondern auch Sicherheitsdaten analysiert, Aufgaben der Reaktion auf Vorfälle an andere Agenten delegiert und sogar erste Bedrohungsberichte erstellt – all das, während Sie sich auf den kreativen, strategischen Kern Ihrer Sicherheitsoperationen konzentrieren.

Das Versprechen von KI-Agenten

Dies ist keine ferne Fantasie, sondern das Versprechen von KI-Agenten. Anders als reaktive KI-Tools, die lediglich auf Befehle reagieren, handelt es sich hierbei um autonome KI-Systeme, die Sicherheitsziele verstehen, mehrstufige Lösungen zur Bedrohungserkennung und -abwehr planen, aus ihrer Umgebung lernen und Aktionen mit minimalem menschlichen Eingriff ausführen können. Sie sind im Wesentlichen digitale Lehrlinge, die sich zu vertrauenswürdigen Partnern in der IT-Sicherheit entwickeln können. Sicherheitsoperationszentrum (SOC).

Die Zukunft der KI: Ein Wandel von passiven zu proaktiven Agenten

Dieser Wandel von passiven Werkzeugen hin zu proaktiven Kollaborateuren stellt einen gewaltigen Sprung dar. Es ist vergleichbar mit dem Übergang von einem Taschenrechner (reaktiv) zu einem Cybersicherheitsanalysten (proaktiv), jedoch mit deutlich größerem Umfang und erweiterten Fähigkeiten. Die Zukunft der KI ist untrennbar mit der Entwicklung dieser Systeme verbunden und verspricht, Sicherheitsoperationen grundlegend zu verändern, die Bedrohungsanalyse zu beschleunigen und Verteidigungsstrategien auf eine Weise zu personalisieren, deren Potenzial wir erst allmählich erahnen.

Das ethische Gebot: Unsere “besseren Engel” im Code für Cybersicherheit fördern

Doch mit immenser Macht geht immense Verantwortung einher. So wie Pinker aufzeigt, wie gesellschaftliche Mechanismen wie Justizsysteme und Handel unsere besseren Seiten verstärkt haben, müssen wir ähnliche “Mechanismen” in unsere KI-Systeme für die Cybersicherheit einbauen.

Ohne einen bewussten, menschenzentrierten Ansatz könnten diese leistungsstarken Werkzeuge unbeabsichtigt unsere Schwächen, Verzerrungen bei der Bedrohungserkennung, Ineffizienzen bei der Reaktion auf Vorfälle und sogar unbeabsichtigten Schaden durch Fehlkonfigurationen oder Fehlalarme verstärken. Hier wird das Konzept ethischer KI-Prinzipien nicht nur theoretisch, sondern absolut entscheidend für die Entwicklung von KI-Systemen im Bereich der Cybersicherheit.

Betrachten wir die von Pinker beschriebene “Sympathie” als eine der besseren Eigenschaften der Menschheit, als unsere Fähigkeit zu Empathie und Fürsorge. Wie können wir ein digitales Äquivalent in einem KI-Agenten verankern, der in einem SOC operiert? Es beginnt mit Folgendem:

Transparenz und Verantwortlichkeit: Entwicklung interpretierbarer KI für mehr Sicherheit

Wenn ein KI-Agent eine Entscheidung trifft, die sich auf die Sicherheitslage einer Organisation oder die Reaktion auf einen bedeutenden Vorfall auswirkt, müssen wir verstehen, dass Warum Und Wie Es kam zu dieser Entscheidung. Dabei geht es nicht nur um die Protokollierung von Daten, sondern um die Entwicklung interpretierbarer KI-Systeme, bei denen die Logik hinter Bedrohungsanalysen und Gegenmaßnahmen für menschliche Analysten zugänglich und nachvollziehbar ist.

Menschzentriertes Design: Die essentielle Rolle der menschlichen Aufsicht

Selbst die hochentwickeltsten KI-Systeme in einem Security Operations Center (SOC) benötigen einen wachsamen Wächter. So wie Pinker argumentiert, dass Vernunft uns befähigt, von impulsiven Handlungen Abstand zu nehmen, bietet menschliche Aufsicht den notwendigen “Stoppknopf” und moralischen Kompass für autonome Sicherheitssysteme. Wir müssen Schnittstellen entwickeln, die ein einfaches Eingreifen, Kurskorrekturen und die letztendliche Autorität menschlichen Urteilsvermögens bei kritischen Sicherheitsentscheidungen ermöglichen.

Fairness und Vermeidung von Verzerrungen: Entwicklung verantwortungsvoller KI in der Cybersicherheit

Unsere digitale Welt ist von historischen Datenverzerrungen durchzogen, und wenn diese nicht sorgfältig angegangen werden, werden sie von KI-Systemen, die aus vorhandenen Bedrohungsdaten oder Sicherheitsprotokollen lernen, aufgenommen und verstärkt. KI in der Cybersicherheit Dies beinhaltet das proaktive Erkennen und Abschwächen dieser Verzerrungen, um sicherzustellen, dass die Mitarbeiter alle Systeme und Benutzer gleichermaßen fair behandeln und keine bestimmten Gruppen oder Anwendungen unfairerweise ins Visier nehmen.

Zweckorientierte Entwicklung: KI-Fähigkeiten zum Wohle aller einsetzen

Wir müssen die unglaublichen Fähigkeiten dieser Systeme bewusst zum Wohle der Cybersicherheit einsetzen. Das bedeutet, Initiativen für den sinnvollen Einsatz von KI im Sicherheitsbereich zu fördern und Systeme zu entwickeln, die komplexe globale Herausforderungen wie Ransomware und Advanced Persistent Threats (APTs) bewältigen und kritische Infrastrukturen schützen. Stellen Sie sich KI-Systeme vor, die die Bedrohungssuche in Echtzeit optimieren oder die Entdeckung neuer Schwachstellen beschleunigen.

Praktische Schritte für einen menschenzentrierten KI-Ansatz in der Cybersicherheit

Die Nutzung der “besseren Eigenschaften” von KI-Systemen ist keine passive Hoffnung, sondern ein aktives Unterfangen, das die Zusammenarbeit verschiedener Disziplinen im Bereich der Cybersicherheit erfordert.

- Für Entwickler und Unternehmen: Die Verantwortung beginnt bereits bei der Konzeption. Wir müssen ethische Rahmenbedingungen von Anfang an in die Architektur der KI-Agentenentwicklung integrieren, um Sicherheit zu gewährleisten. Dazu gehören strenge Tests auf unbeabsichtigte Folgen automatisierter Reaktionen, die Priorisierung robuster Sicherheitsmaßnahmen, um Missbrauch oder Kompromittierung der Agenten selbst zu verhindern, und die Entwicklung intuitiver Steuerungsschnittstellen, die Sicherheitsanalysten unterstützen, anstatt sie einzuschüchtern.

- Für Regulierungsbehörden und politische Entscheidungsträger: Die globale Natur von Cyberbedrohungen und KI erfordert internationale Zusammenarbeit. Flexible und gleichzeitig robuste KI-Governance-Rahmen sind unerlässlich, um Innovationen bei Sicherheitslösungen zu fördern und gleichzeitig vor den Risiken autonomer Systeme zu schützen. Investitionen in die KI-Sicherheitsforschung sind entscheidend, da sie sowohl die Erforschung technischer Lösungen als auch die Untersuchung der gesellschaftlichen Auswirkungen weitverbreiteter autonomer Sicherheitssysteme umfassen.

- Für Nutzer und die Öffentlichkeit: Unsere Aufgabe ist es, informiert und engagiert zu sein. Wir müssen Transparenz und Kontrolle über die KI-Systeme fordern, mit denen wir interagieren, ihre Grenzen verstehen und uns für ihren ethischen Einsatz zum Schutz unseres digitalen Lebens einsetzen. Unsere gemeinsame Stimme kann die Entwicklung dieser Technologie mitgestalten.

Ein Aufruf zu bewusster KI und menschlicher Koexistenz in der Cybersicherheit

Wie Pinker so eindrücklich argumentiert, sind die “besseren Seiten unserer Natur” mächtige Kräfte, die die Menschheit langsam, aber sicher zu einem friedlicheren und wohlhabenderen Dasein geführt haben. Jetzt, da wir am Beginn des Zeitalters der KI-Agenten in der Cybersicherheit stehen, bietet sich uns eine bedeutende Chance und sogar eine moralische Verpflichtung, diesen mächtigen neuen Wesen dieselben edlen Impulse einzuhauchen.

Die Zukunft von KI-Systemen in der Cybersicherheit ist nicht vorherbestimmt. Sie ist eine Leinwand, die wir als Entwickler, politische Entscheidungsträger und Sicherheitsexperten gestalten. Lasst uns eine Zukunft erschaffen, in der menschenzentrierte KI nicht nur ein Schlagwort, sondern eine Leitphilosophie ist. Eine Zukunft, in der KI-Systeme intelligent und weise Sicherheitsentscheidungen treffen; nicht nur effizient in der Bedrohungsabwehr, sondern auch ethisch korrekt. Lasst uns bewusst Systeme entwickeln, die unsere tiefsten Werte widerspiegeln, das menschliche Potenzial im Security Operations Center (SOC) stärken und unermüdlich an einer Zukunft arbeiten, die von unseren eigenen ethischen Grundsätzen geprägt ist.“

TL;DR

Der Übergang zu autonomen KI-Agenten in der Cybersicherheit erfordert die bewusste Einbettung ethischer Prinzipien (“bessere Engel”), insbesondere Transparenz, menschliche Aufsicht und die Minderung von Verzerrungen, um sicherzustellen, dass sie vertrauenswürdig sind.

Dieser menschenzentrierte Ansatz verwandelt KI-Agenten von bloßen Werkzeugen in zuverlässige, ethische Partner und gewährleistet so, dass Sicherheitsteams mit Zuversicht wirklich verantwortungsbewusste Agenten einsetzen können.

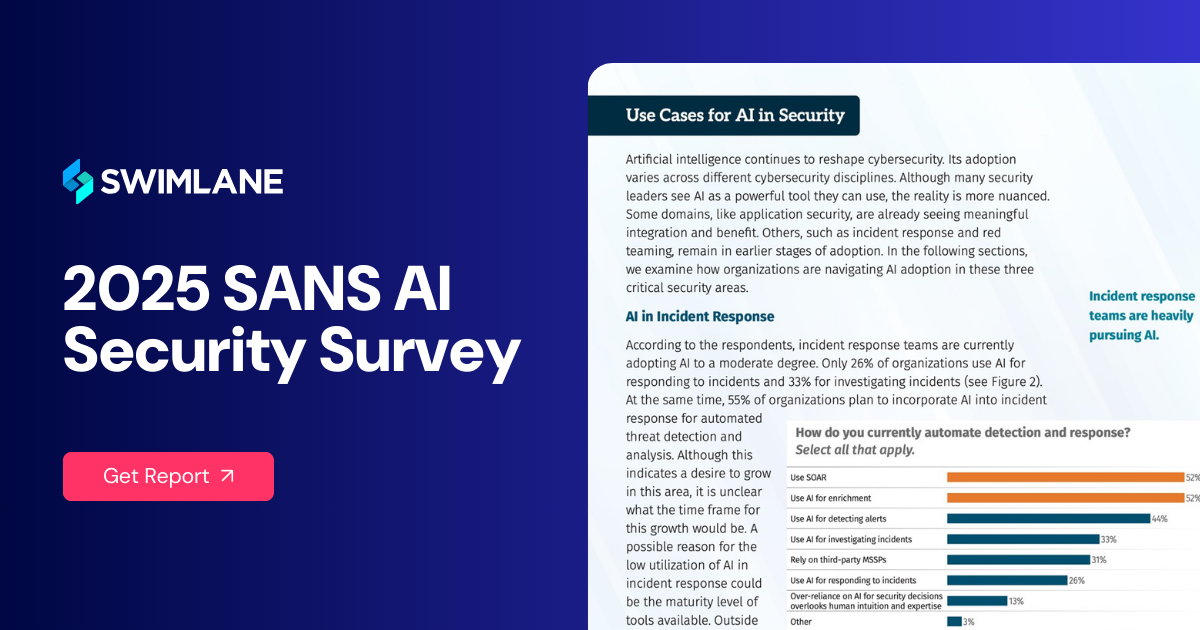

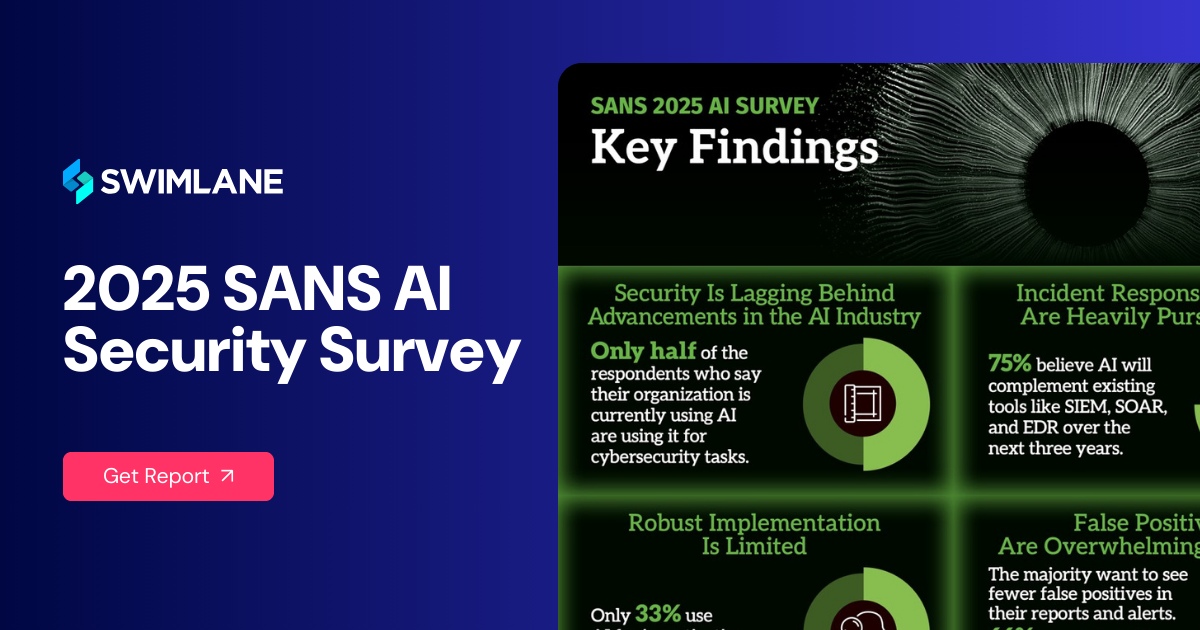

Bericht

SANS-KI-Umfrage 2025: Die Auswirkungen von KI auf die Sicherheit drei Jahre später

Generative KI (GenAI) und große Sprachmodelle (LLMs) sind bereits Realität und prägen die Landschaft der Cybersicherheit.

Die von Ahmed Abugharbia und Brandon Evans verfasste SANS AI Survey 2025 untersucht, wie Organisationen GenAI derzeit für Sicherheitszwecke einsetzen und identifiziert die Probleme und Bedrohungen, die von diesen neuen Technologien ausgehen.