Os Melhores Anjos dos Agentes de IA: Cibersegurança Ética em Sistemas Autônomos

O que é um agente de IA?

Uma entidade de software orientada a objetivos, à qual uma organização concedeu o direito de agir em seu nome para tomar decisões e executar ações de forma autônoma. Essas entidades utilizam técnicas de IA, combinadas com componentes como memória, planejamento, ferramentas e mecanismos de controle, para concluir tarefas e atingir objetivos com supervisão humana mínima.

O zumbido dos servidores, o cintilar das telas, a marcha implacável do progresso tecnológico – podemos ter a sensação de que estamos sendo lançados a passos largos rumo a um futuro moldado por forças além do nosso controle. Contudo, enquanto nos encontramos à beira da revolução dos agentes de IA, temos uma oportunidade profunda de direcionar seu curso. Não se trata apenas de construir máquinas mais inteligentes; trata-se de invocar o que Abraham Lincoln chamou de “os melhores anjos da nossa natureza”, aqueles impulsos mais nobres que nos guiam para a cooperação, a empatia e o bem coletivo. Assim como Steven Pinker detalhou meticulosamente como a humanidade, ao longo dos milênios, abraçou cada vez mais seus melhores anjos para reduzir a violência e elevar a razão, devemos agora imbuir conscientemente nossos agentes de IA autônomos com os mesmos princípios, reduzindo, assim, erros dispendiosos e riscos de segurança cibernética.

A Ascensão da Inteligência Autônoma: Um Novo Capítulo no Progresso da Segurança Cibernética

Imagine um mundo onde seu agente de IA gerencia proativamente seus projetos complexos de cibersegurança, não apenas lembrando-o de prazos, mas também analisando dados de segurança, delegando tarefas de resposta a incidentes a outros agentes e até mesmo elaborando relatórios iniciais de ameaças – tudo isso enquanto você se concentra no núcleo criativo e estratégico de suas operações de segurança.

A promessa dos agentes de IA

Isso não é uma fantasia distante; é a promessa dos agentes de IA. Ao contrário das ferramentas de IA reativas que simplesmente respondem aos seus comandos, essas são entidades de IA autônomas capazes de compreender objetivos de segurança, planejar soluções complexas para detecção e resposta a ameaças, aprender com o ambiente e executar ações com mínima intervenção humana. Elas são, em essência, aprendizes digitais, capazes de evoluir para parceiros confiáveis na área de segurança. Centro de Operações de Segurança (SOC).

O futuro da IA: uma transição de agentes passivos para proativos.

Essa transição de ferramentas passivas para colaboradores proativos representa um salto monumental. É como passar de uma calculadora (reativa) para um analista de cibersegurança (proativo), mas com um alcance e capacidade muito maiores. O futuro da IA está intrinsecamente ligado ao desenvolvimento desses agentes, prometendo redefinir as operações de segurança, acelerar a inteligência de ameaças e personalizar estratégias de defesa de maneiras que estamos apenas começando a compreender.

O Imperativo Ético: Cultivando Nossos "Melhores Anjos" no Código para a Segurança Cibernética

No entanto, com imenso poder vem imensa responsabilidade. Assim como Pinker ilustra como mecanismos sociais como os sistemas de justiça e o comércio amplificaram o que há de melhor em nós, devemos projetar "mecanismos" semelhantes em nossos agentes de IA para segurança cibernética.

Sem uma abordagem deliberada e centrada no ser humano, essas ferramentas poderosas podem, inadvertidamente, amplificar nossos instintos menos nobres, vieses na detecção de ameaças, ineficiências na resposta a incidentes e até mesmo danos não intencionais por meio de configurações incorretas ou falsos positivos. É aqui que o conceito de princípios éticos de IA se torna não apenas teórico, mas absolutamente crucial para o desenvolvimento de agentes de IA no domínio da cibersegurança.

Considere a “simpatia” que Pinker descreve como um dos melhores atributos da humanidade, nossa capacidade de empatia e cuidado. Como podemos incutir um equivalente digital em um agente de IA operando em um SOC? Tudo começa com:

Transparência e Responsabilidade: Construindo IA Interpretável para Segurança

Se um agente de IA tomar uma decisão que impacte a postura de segurança de uma organização ou uma resposta a incidentes significativos, precisamos entender por que e como A decisão foi tomada. Não se trata apenas de registrar dados; trata-se de construir sistemas de IA interpretáveis, onde a lógica por trás das avaliações de ameaças e das ações de mitigação seja acessível e auditável por analistas humanos.

Design com participação humana: o papel essencial da supervisão humana

Mesmo os agentes de IA mais sofisticados em um SOC precisam de um guardião vigilante. Assim como Pinker argumenta que a razão nos permite recuar diante de ações impulsivas, a supervisão humana fornece o necessário "botão de pausa" e a bússola moral para sistemas de segurança autônomos. Devemos projetar interfaces que permitam intervenção fácil, correção de rumo e a autoridade máxima do julgamento humano em decisões críticas de segurança.

Equidade e Mitigação de Viés: Criando IA Responsável em Cibersegurança

Nosso mundo digital está repleto de vieses históricos nos dados e, se não forem tratados meticulosamente, esses vieses serão absorvidos e amplificados por agentes de IA que aprendem com informações de ameaças ou registros de segurança existentes. Criar soluções responsáveis é fundamental. Inteligência artificial em cibersegurança Envolve a identificação e mitigação proativa desses vieses, garantindo que os agentes considerem todos os sistemas e usuários com equidade e não visem injustamente grupos ou aplicativos específicos.

Desenvolvimento orientado por propósito: direcionando as capacidades da IA para o bem comum.

Devemos direcionar conscientemente as incríveis capacidades desses agentes para o bem maior da cibersegurança. Isso significa fomentar iniciativas de IA para o bem na área de segurança, projetando agentes que enfrentem desafios globais complexos, como ransomware, ameaças persistentes avançadas e proteção de infraestruturas críticas. Imagine agentes de IA otimizando a busca por ameaças em tempo real ou acelerando a descoberta de novas vulnerabilidades.

Passos práticos para uma abordagem de IA centrada no ser humano em cibersegurança

Acolher o "lado bom" dos agentes de IA não é uma esperança passiva; é um esforço ativo que exige colaboração entre diversas disciplinas na área de segurança cibernética.

- Para desenvolvedores e empresas: A responsabilidade começa na fase de projeto. Devemos incorporar princípios éticos na própria arquitetura do desenvolvimento de agentes de IA para garantir a segurança. Isso inclui testes rigorosos para identificar consequências não intencionais em respostas automatizadas, priorizar uma segurança robusta para evitar o uso indevido ou a vulnerabilidade dos próprios agentes e criar interfaces de controle intuitivas que capacitem os analistas de segurança, em vez de intimidá-los.

- Para reguladores e formuladores de políticas: A natureza global das ameaças cibernéticas e da IA exige cooperação internacional. Estruturas de governança de IA flexíveis, porém firmes, são essenciais, incentivando a inovação em soluções de segurança e, ao mesmo tempo, protegendo contra os riscos representados por sistemas autônomos. Investir em pesquisa sobre segurança da IA é crucial, pois envolve explorar soluções técnicas e examinar as implicações sociais da disseminação de sistemas de segurança autônomos.

- Para usuários e público em geral: Nosso papel é estarmos informados e engajados. Devemos exigir transparência e controle sobre os agentes de IA com os quais interagimos, compreendendo suas limitações e defendendo seu uso ético na proteção de nossas vidas digitais. Nossa voz coletiva pode moldar o rumo dessa tecnologia.

Um apelo à IA consciente e à coexistência humana na cibersegurança.

Os “anjos melhores da nossa natureza”, como Pinker argumenta tão eloquentemente, são forças poderosas que, lenta mas seguramente, têm guiado a humanidade rumo a uma existência mais pacífica e próspera. Agora, à beira da era dos agentes de IA na cibersegurança, temos uma oportunidade profunda, e de fato uma obrigação moral, de imbuir essas novas e poderosas entidades com os mesmos impulsos nobres.

O futuro dos agentes de IA na cibersegurança não está predeterminado. É uma tela em branco na qual nós, como designers, formuladores de políticas e profissionais de segurança, pintaremos. Que escolhamos pintar um futuro onde a IA centrada no ser humano não seja apenas uma palavra da moda, mas uma filosofia orientadora. Um futuro onde os agentes de IA sejam inteligentes e também sábios em suas decisões de segurança; não apenas eficientes na resposta a ameaças, mas também éticos em suas operações. Que escolhamos conscientemente construir agentes que reflitam nossos valores mais profundos, amplificando o potencial humano no SOC e trabalhando incansavelmente por um futuro moldado por nossos próprios "melhores instintos".“

Resumindo:

A transição para agentes de IA autônomos em cibersegurança exige a incorporação consciente de princípios éticos ("bons princípios"), especificamente, transparência, supervisão humana e mitigação de vieses para garantir que sejam confiáveis.

Essa abordagem centrada no ser humano transforma os agentes de IA de meras ferramentas em parceiros confiáveis e éticos, garantindo que as equipes de segurança possam implantar com confiança agentes verdadeiramente responsáveis.

Relatório

Pesquisa SANS 2025 sobre IA: O impacto da IA na segurança três anos depois

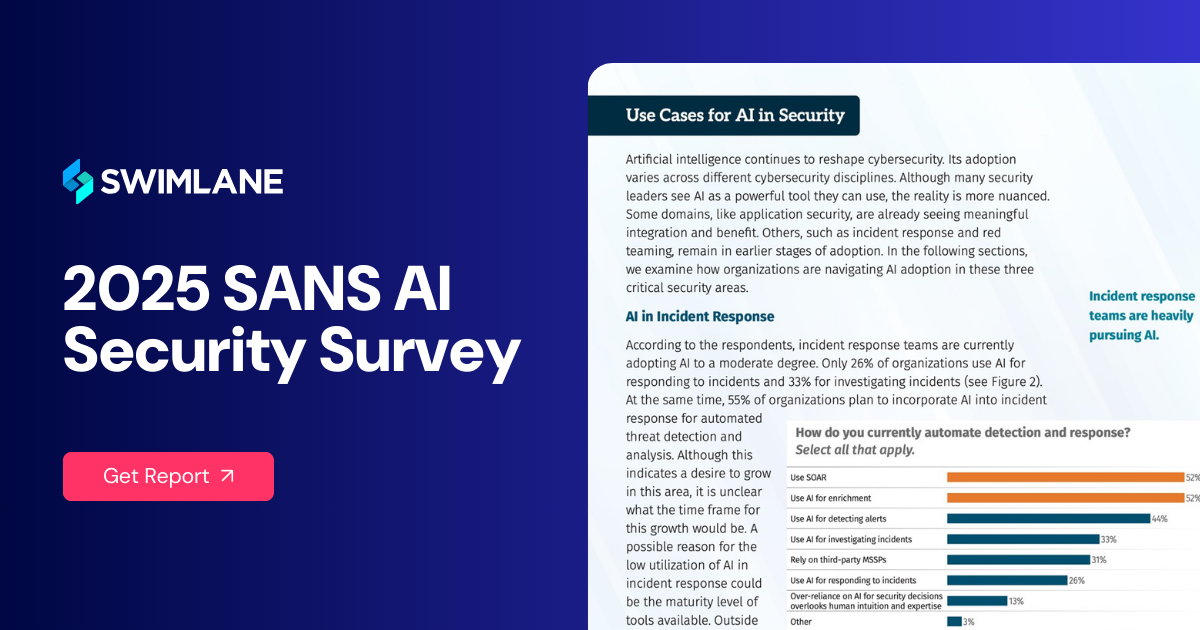

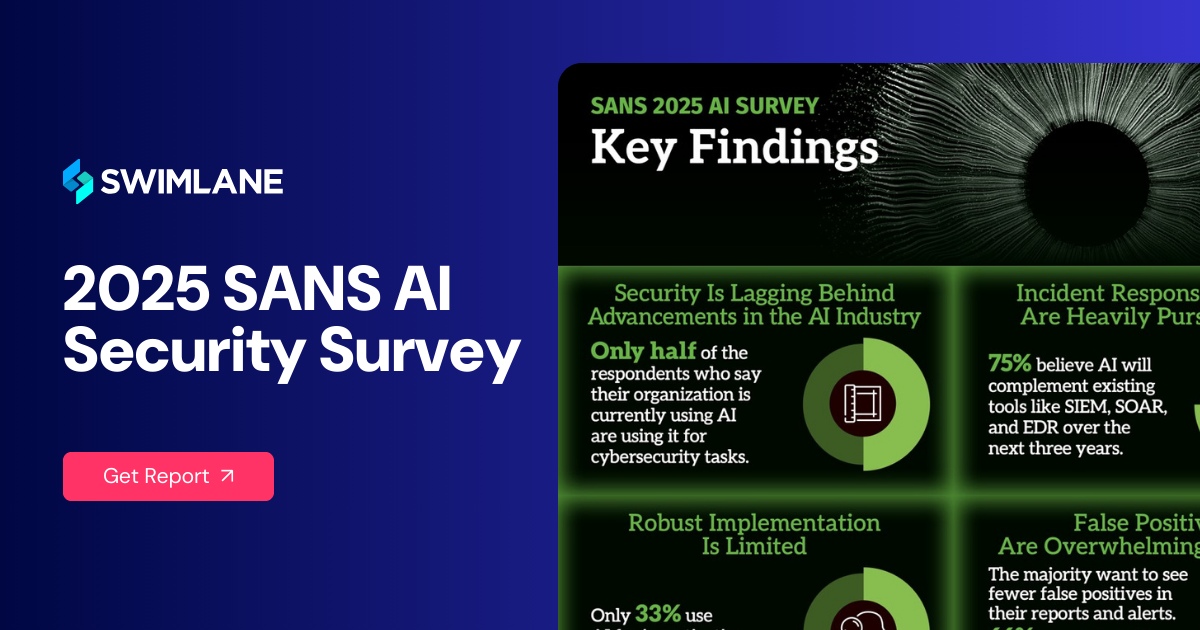

A Inteligência Artificial Generativa (GenAI) e os grandes modelos de linguagem (LLMs) já são uma realidade, moldando o cenário da segurança cibernética.

A Pesquisa de IA da SANS de 2025, de autoria de Ahmed Abugharbia e Brandon Evans, examina como as organizações estão utilizando atualmente a IA de Geração para segurança e identifica os problemas e ameaças representados por essas novas tecnologias.