Um guia para orquestrar investigações de ponta a ponta com IA.

Este post do blog é o terceiro de uma série de quatro partes sobre a frota de agentes de IA especializados da Swimlane e se concentra no Agente de Investigação de IA Hero. Este agente elimina o problema dispendioso da troca de contexto, que consome um tempo significativo do analista enquanto ele alterna entre várias ferramentas para coletar informações. Atuando como o "cérebro" do SOC de IA, o Agente de Investigação sintetiza informações de alta fidelidade de outros agentes e as avalia em relação aos manuais de procedimentos definidos pelo cliente e ao conhecimento institucional para produzir um plano de resposta completo, priorizado, alinhado ao NIST e dividido em quatro fases.

Se você tem acompanhado esta série, já falamos sobre dois agentes da Swimlane. IA Heroica frota até o momento: a Agente MITRE ATT&CK & D3FEND que padroniza a forma como você descreve ataques e defesas, e o Agente de Inteligência de Ameaças que sintetiza informações de múltiplas fontes em uma avaliação única e explicável.

Ambos os agentes resolvem problemas reais, mas são apenas insumos. Eles produzem contexto. O que acontece a seguir, dado esse contexto, é onde as investigações podem prosperar ou fracassar.

É aqui que o Agente de Investigação É aí que entra o conceito de frota, e honestamente, é o que mais me empolga explorar, porque é onde o conceito deixa de ser teórico e começa a produzir resultados concretos de ponta a ponta.

É também aí que a confiança progressiva se torna real. Quando um agente está enriquecendo indicadores ou mapeando técnicas do ATT&CK, o impacto de um erro é pequeno. Quando um agente está elaborando um plano de investigação, gerando um cronograma e recomendando ações de contenção, a conversa é completamente diferente.

O nível de exigência é maior, os riscos são maiores e a confiança precisa ser conquistada de forma diferente.

Mas aqui está o ponto: este é também o agente que desbloqueia o resultado que todo líder de SOC realmente deseja, fechando automaticamente as tarefas óbvias com segurança para que sua equipe possa se concentrar no que importa.

O Imposto de Mudança de Contexto

Antes de entrarmos em detalhes sobre como... IA Heroica O Investigation Agent funciona, vamos falar sobre o problema que ele resolve, porque acredito que seja um dos maiores inimigos da produtividade em operações de segurança, embora subestimado.

Quando um alerta é acionado e um analista começa a investigar, ele não está fazendo apenas uma coisa.

- Eles estão extraindo o contexto dos alertas do SIEM. Estão verificando a reputação dos indicadores na plataforma de inteligência de ameaças (TI).

- Eles estão analisando os registros antigos para verificar se esse host ou usuário já apareceu antes.

- Eles estão fazendo uma comparação com a estrutura MITRE para entender o padrão de ataque.

- Eles estão consultando o manual de procedimentos para verificar como é o procedimento de resposta documentado.

- Eles vão anotando tudo conforme avançam. E então, com base em todo esse trabalho, fazem uma recomendação: intensificar, conter ou encerrar o caso.

Cada uma dessas etapas reside em uma ferramenta, aba ou fluxo de trabalho diferente. O analista é a camada de integração, e o custo dessa integração é a troca de contexto. Cada vez que ele alterna entre ferramentas, perde o ritmo. Ele precisa se reorientar, reler e recontextualizar.

A troca de sistemas pode consumir de 20 a 40% de tempo produtivo e, na minha experiência gerenciando equipes de SOC, isso é uma estimativa conservadora para trabalhos de investigação.

O Agente de Investigação elimina esse custo adicional fazendo o que um analista sênior faz, mas a partir de uma única interface, sem a sobrecarga cognitiva de alternar entre ferramentas.

Como funciona o agente de investigação

O Agente de Investigação atua como o “cérebro” da equipe. SOC de IA, E essa estrutura faz sentido quando se observa como ela funciona. Não opera isoladamente; ela ingere os dados de alta fidelidade dos outros três agentes da frota e os sintetiza em uma investigação completa.

Fluxo de trabalho do agente de investigação e resposta

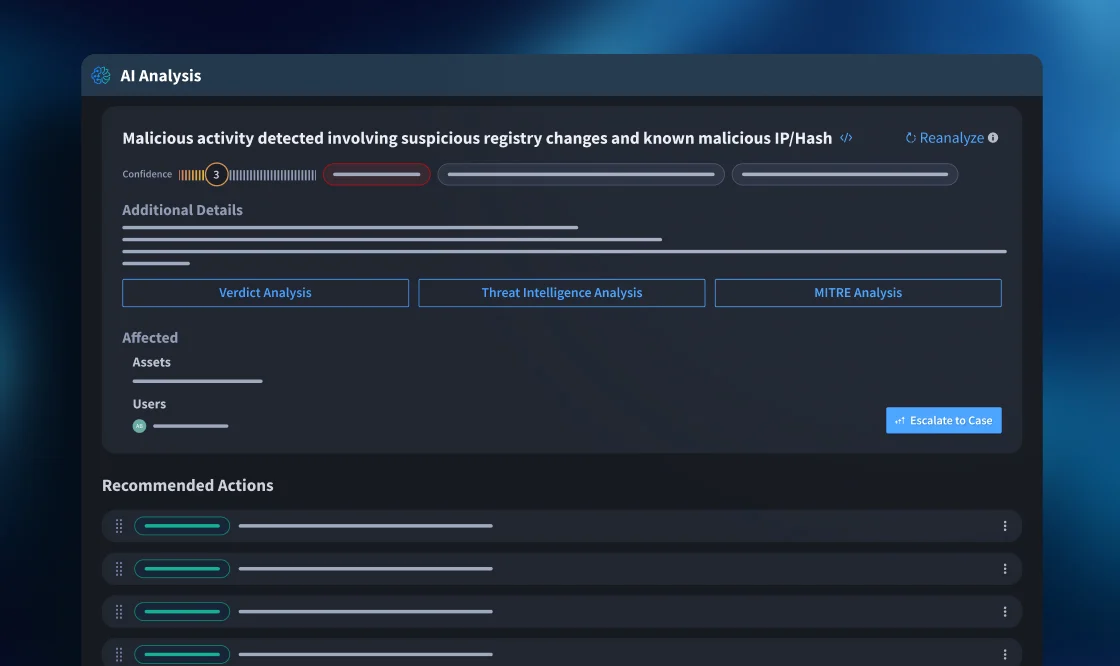

O agente começa por reunir todas as informações disponíveis sobre o caso, incluindo os dados brutos do alerta, o enriquecimento e o contexto. Em seguida, incorpora a análise unificada de múltiplas fontes do Agente de Inteligência de Transmissão (TI), os mapeamentos de técnicas e contramedidas do agente MITRE e a avaliação preliminar do Agente de Veredicto.

Essa é a base da inteligência.

Em seguida, faz algo que a maioria das ferramentas de automação não faz: avalia tudo isso em relação aos seus manuais de procedimentos definidos pelo cliente e aos artigos da base de conhecimento. É aqui que o conhecimento institucional entra em jogo: os procedimentos documentados, as lições aprendidas com incidentes anteriores e o conhecimento tácito que sua equipe (esperamos) tenha acumulado ao longo do tempo.

O agente utiliza o NIST Incident Response Framework como base, fornecendo ao resultado uma estrutura universalmente compreendida pelas equipes de segurança.

Resultados da investigação do agente: Plano de resposta em quatro fases

O resultado é um plano de resposta priorizado, organizado em quatro fases:

- Contenção: Impedir que a ameaça se espalhe.

- Erradicação: remover a causa raiz

- Recuperação: restabelecer as operações normais

- Endurecimento: prevenir recorrência

Cada recomendação é prática, não um vago "considere investigar mais a fundo", mas sim etapas específicas que um analista pode executar ou, quando a confiança for conquistada, que a plataforma pode executar de forma autônoma.

Ao longo do processo, o agente gera resumos de investigação, cronogramas e ações recomendadas por meio de uma única interface unificada. Sem necessidade de alternar entre abas, correlacionar manualmente ou reconstruir o contexto a cada troca de ferramenta. O analista obtém uma visão completa e um plano claro.

É aqui que a avaliação comparativa de SoCs com IA se torna realidade.

Ok, esta é a parte em que realmente quero me aprofundar, porque é o conceito mais importante de toda a série, e o Agente de Investigação é onde ele se torna tangível.

Tenho afirmado ao longo destes posts que a IA no SOC não precisa ser perfeita para ser útil. Ela precisa alcançar resultados iguais ou superiores aos humanos, com explicabilidade suficiente para que um analista possa validar o raciocínio. A maneira de comprovar isso não é com demonstrações de fornecedores ou promessas de marketing, mas sim comparando o desempenho com o de seus próprios analistas, utilizando seus próprios dados.

A Swimlane fez exatamente isso com seu SOC interno. Eles analisaram cerca de 35.000 investigações humanas, casos reais, decisões reais e anotações reais de analistas, e usaram esse conjunto de dados para comparar, verificar e ajustar os resultados dos agentes. Isso não é um exercício de laboratório. É comparar o que a IA teria recomendado com o que analistas experientes realmente fizeram, caso a caso e em grande escala.

Dicas para equipes de IA em SOC

Essa é a metodologia que eu defendo sempre que trabalho com uma equipe na adoção de IA.

Comece com sua matéria-prima. Você precisa de registros históricos e das anotações dos analistas que capturam o histórico. por que Algo foi encerrado, escalado ou classificado como benigno. O "porquê" é a parte crucial, não apenas a decisão, mas também o raciocínio por trás dela.

Se seus analistas estão fechando chamados com anotações de uma palavra, você tem um problema de documentação para resolver antes de ter um problema de IA para resolver. Se você já possui bases de conhecimento e manuais de procedimentos, ótimo, o Agente de Investigação pode avaliar os casos com base neles. Caso contrário, você pode usar IA para gerá-los a partir de casos antigos.

Tenho obtido bons resultados usando o Claude Sonnet para isso: alimente-o com um lote de tickets históricos com anotações de analistas e deixe que ele extraia os padrões, critérios de decisão e procedimentos de resposta em artigos estruturados da base de conhecimento. Considere isso como sua base de conhecimento inicial e refine a partir daí.

Em seguida, você itera. Execute o Agente de Investigação juntamente com seus analistas. Compare os planos de investigação, cronogramas e ações recomendadas com o que sua equipe produz de forma independente. Monitore os pontos de concordância, as divergências e os motivos.

Procure por padrões. O agente é consistentemente mais minucioso no enriquecimento de dados, mas ocasionalmente deixa passar algum contexto que um analista experiente identificaria? Ele recomenda ações de contenção com as quais sua equipe concorda na maioria das vezes?

Esse processo de avaliação comparativa é como o agente conquista o direito a mais autonomia. Não é uma mudança instantânea. É um processo de confiança progressiva.

Construindo sua base de conhecimento em IA

Quero concluir com algo prático, porque é aqui que vejo a maioria das organizações travar. Elas querem o resultado do fechamento automático, mas ignoram a base de conhecimento que o torna possível.

O Agente de Investigação só é tão bom quanto os manuais e artigos da base de conhecimento que utiliza para avaliar os casos. Se o conhecimento institucional reside exclusivamente na mente dos analistas seniores — e sejamos honestos, na maioria dos SOCs é assim —, então o agente não tem o contexto necessário para fazer boas recomendações.

Você receberá planos de investigação genéricos em vez de planos personalizados para a forma como sua equipe lida com tipos específicos de casos.

A solução é mais simples do que a maioria das pessoas pensa. Analise os chamados fechados dos últimos 6 a 12 meses. Concentre-se naqueles com notas de analistas relevantes (mesmo que sejam inconsistentes, isso é normal). Use IA para extrair padrões comuns: quais tipos de alertas geraram esses casos, quais etapas de enriquecimento foram tomadas, quais foram os critérios de decisão típicos e quais ações foram recomendadas.

Estruture isso em artigos da base de conhecimento e manuais de procedimentos. Não precisa ser perfeito; você precisa de um ponto de partida que os agentes possam consultar e que sua equipe possa aprimorar ao longo do tempo.

Já fiz isso em diversos ambientes e os resultados são notavelmente consistentes. Poucas semanas após a criação da base de conhecimento e a execução da frota em modo de teste, você começa a ver os agentes elaborando planos de investigação que correspondem ao que seus analistas teriam feito.

Em poucos meses de testes comparativos, você já estará identificando seus primeiros candidatos para fechamento automático. Em um trimestre, você estará fechando com confiança uma porcentagem significativa de casos de Nível 1 de forma autônoma, e seus analistas estarão dedicando seu tempo às investigações que realmente exigem julgamento humano.

Essa é a SOC de IA. Não um modelo mágico que substitui sua equipe no primeiro dia. Uma frota de agentes desenvolvidos especificamente para uma finalidade, cada um com uma função específica, que se complementam e, coletivamente, conquistam maior responsabilidade ao longo do tempo. O Agente de Investigação é onde tudo isso se une e onde o retorno sobre o investimento se torna real.

Na última publicação desta série, abordarei o Agente de Veredicto, aquele que de fato toma a decisão. Se o Agente de Investigação é o cérebro, o Agente de Veredicto é quem decide. Fiquem ligados.

Pronto para comparar o desempenho do seu SOC com o da IA?

Seus analistas não devem ser a camada de integração entre seis ferramentas em cada investigação. O Agente de Investigação de IA Hero, da Swimlane, cria planos de investigação completos e alinhados com o NIST a partir de uma única interface e, em seguida, ajuda você a comparar resultados, construir confiança e começar a fechar automaticamente os casos que não precisam de intervenção humana.

Resumindo: O Agente de Investigação de IA Herói

Este agente atua como o cérebro do SOC de IA, mas sua eficácia depende inteiramente da sua base de conhecimento existente. Os líderes de segurança precisam parar de deixar o conhecimento institucional restrito a analistas seniores, pois essa é a principal razão pela qual as organizações hesitam em implementar o fechamento automático.

Para corrigir isso:

- Mandato para extrair os últimos 6 a 12 meses de chamados fechados, incluindo as notas dos analistas.

- Utilize IA para identificar e extrair padrões comuns:

- Tipos de alerta

- Critérios de decisão

- Ações recomendadas

- Estruture essas percepções em uma base de conhecimento fundamental exigida pelo agente.

- Aplique uma estrutura de confiança progressiva para operacionalizar esse conhecimento.

- Em um trimestre, possibilite o encerramento automático e confiável de uma porcentagem significativa de casos de Nível 1, de forma autônoma, tornando o retorno sobre o investimento (ROI) do agente de investigação tangível e liberando sua equipe para se concentrar em trabalhos complexos que exigem julgamento humano.