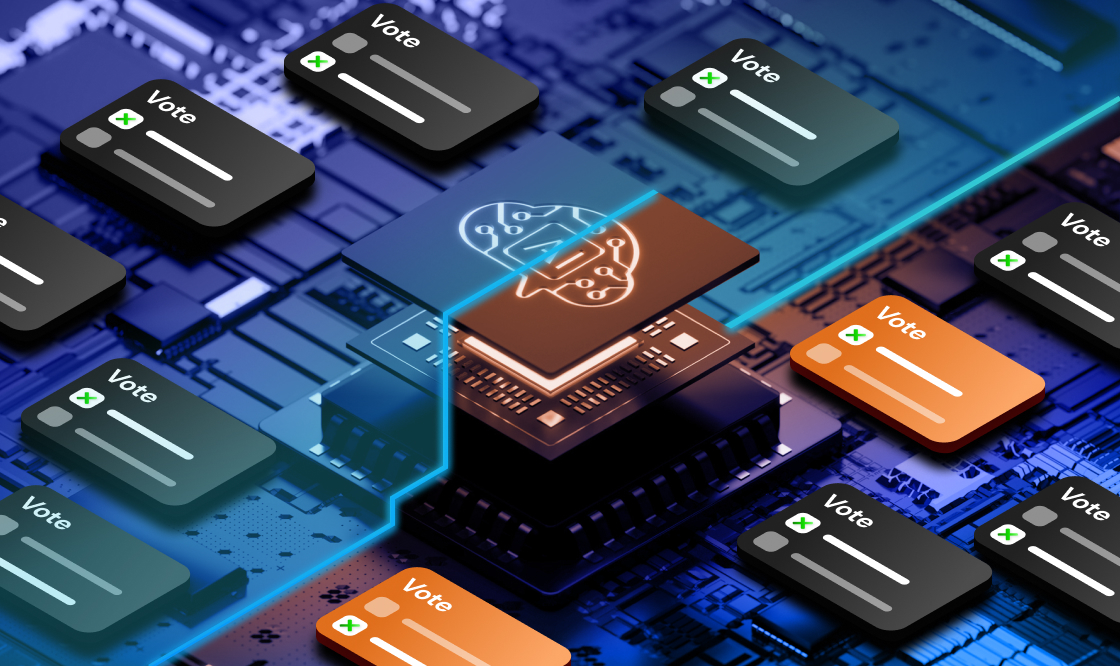

À un mois des élections américaines de 2024, il ne fait aucun doute que l'IA joue un rôle sans précédent dans la formation de l'opinion publique. Si l'IA a stimulé l'innovation dans tous les secteurs, elle est aussi devenue de plus en plus accessible à ceux qui cherchent à exploiter ses capacités à des fins de désinformation et de tromperie.

En tant que Bureau du directeur du renseignement national décrit fin septembre, La Russie et l'Iran utilisent l'IA pour influencer l'élection américaine. Cet avertissement confirme que les campagnes de désinformation générées par l'IA, déjà observées lors d'élections internationales cette année, se produisent désormais aux États-Unis. À l'approche du dernier mois avant l'élection, cette montée en puissance de la désinformation générée par l'IA, notamment les deepfakes, pose de nouveaux défis aux électeurs, aux gouvernements et aux plateformes de médias sociaux.

La désinformation en hausse

couloir de nage Nous avons récemment mené une enquête auprès de 500 décideurs en cybersécurité concernant leur perception de l'IA au travail et ailleurs. Bien que le rapport complet soit attendu pour octobre, une statistique nous semblait particulièrement importante : 74% des décideurs en matière de cybersécurité s'accordent à dire que l'utilisation de l'IA pour générer des informations trompeuses représente un risque important pour les États-Unis.. Ces personnes savent pertinemment que l'intelligence artificielle devient plus abordable et plus accessible. Par conséquent, le volume d'informations trompeuses ne fera qu'augmenter d'ici le 5 novembre.

L'intelligence artificielle n'est plus l'apanage des organisations les mieux dotées. Aujourd'hui, toute personne disposant d'une connexion internet et de connaissances de base peut accéder aux outils d'IA. Si cette démocratisation est enthousiasmante à bien des égards, elle ouvre aussi la boîte de Pandore des contenus truqués – des vidéos deepfake aux articles trompeurs – qui menacent d'inonder les plateformes en ligne.

L'une des menaces les plus alarmantes liées à l'IA est l'essor des deepfakes : des vidéos extrêmement convaincantes qui fabriquent de manière réaliste des actions ou des déclarations d'individus, soulevant de profondes questions éthiques et sociétales. deepfake impliquant Taylor Swift Ce fut un rappel glaçant de la facilité avec laquelle des personnalités connues peuvent être prises pour cibles. Et ce n'est qu'un exemple parmi tant d'autres cette année.

La désinformation visuelle est particulièrement dangereuse car les gens ont tendance à faire confiance instinctivement à ce qu'ils voient. Il devient ainsi plus difficile pour le citoyen lambda de distinguer les contenus authentiques des contenus falsifiés. Les conséquences sont considérables, notamment dans le domaine politique, où les deepfakes pourraient discréditer les candidats ou manipuler les électeurs.

Zones grises juridiques et éthiques

L'intersection entre l'IA et la désinformation soulève des questions complexes, notamment en matière de liberté d'expression. Les deepfakes et les contenus manipulés par l'IA brouillent la frontière entre expression créative et intention malveillante. À quel moment un contenu modifié cesse-t-il d'être une forme d'art ou de satire pour devenir un mensonge dangereux ?

D'un point de vue juridique, cette question est particulièrement complexe. Si certaines lois encadrent la désinformation, l'évolution constante des contenus générés par l'IA rend leur application difficile. L'Union européenne a récemment formalisé sa législation en la matière. Loi sur l'intelligence artificielle, Ce texte constitue la première réglementation des systèmes d'IA au sein de l'UE. Toutefois, aux États-Unis, la réglementation fédérale actuelle encadrant les deepfakes et les contenus d'IA pourrait ne pas tenir compte des progrès technologiques rapides, laissant ainsi d'importants enjeux éthiques et juridiques en suspens.

Où allons-nous à partir d'ici

Les mêmes techniques d'intelligence artificielle utilisées pour influencer les élections – qu'il s'agisse de deepfakes, de voix falsifiées ou de SMS ultra-personnalisés – sont de plus en plus employées pour compromettre des organisations. En réalité, l'IA ne sert pas uniquement à la manipulation politique ; elle est également utilisée pour des attaques de phishing très ciblées, comme celles qui incitent les nouveaux acquéreurs de maisons à virer leur paiement final sur un mauvais compte grâce à l'envoi d'un courriel personnalisé et opportun.

Ce niveau de sophistication ouvre de nouvelles perspectives aux attaquants, étendant ainsi une surface d'attaque déjà considérable. À mesure que la dépendance technologique s'accentue dans tous les secteurs, le volume et la complexité des cybermenaces ne feront que croître.

Pour faire face à cette escalade rapide, les entreprises doivent adopter automation et intégrer IA dans leurs systèmes de défense. L'IA étant utilisée des deux côtés – par les attaquants comme par les défenseurs – l'efficacité sera primordiale. La voie à suivre est claire : il ne s'agit pas seulement de garder une longueur d'avance sur les attaquants, mais d'évoluer avec eux, en utilisant l'IA pour relever les défis d'un environnement numérique toujours plus complexe.

Rapport TAG Cyber Tech : L’IA au service de l’automatisation des opérations de sécurité

Le rapport d'analyse débute par un bref aperçu du marché SOAR et retrace la transformation de Swimlane, d'une plateforme SOAR à une plateforme d'automatisation de la sécurité optimisée par l'IA. Pour mieux comprendre l'utilisation de l'IA par Swimlane, consultez le rapport complet.